La langue des signes déchiffrée à partir d'une caméra smartphone

Vu 3 506 fois

La langue des signes déchiffrée à partir d'une caméra smartphone

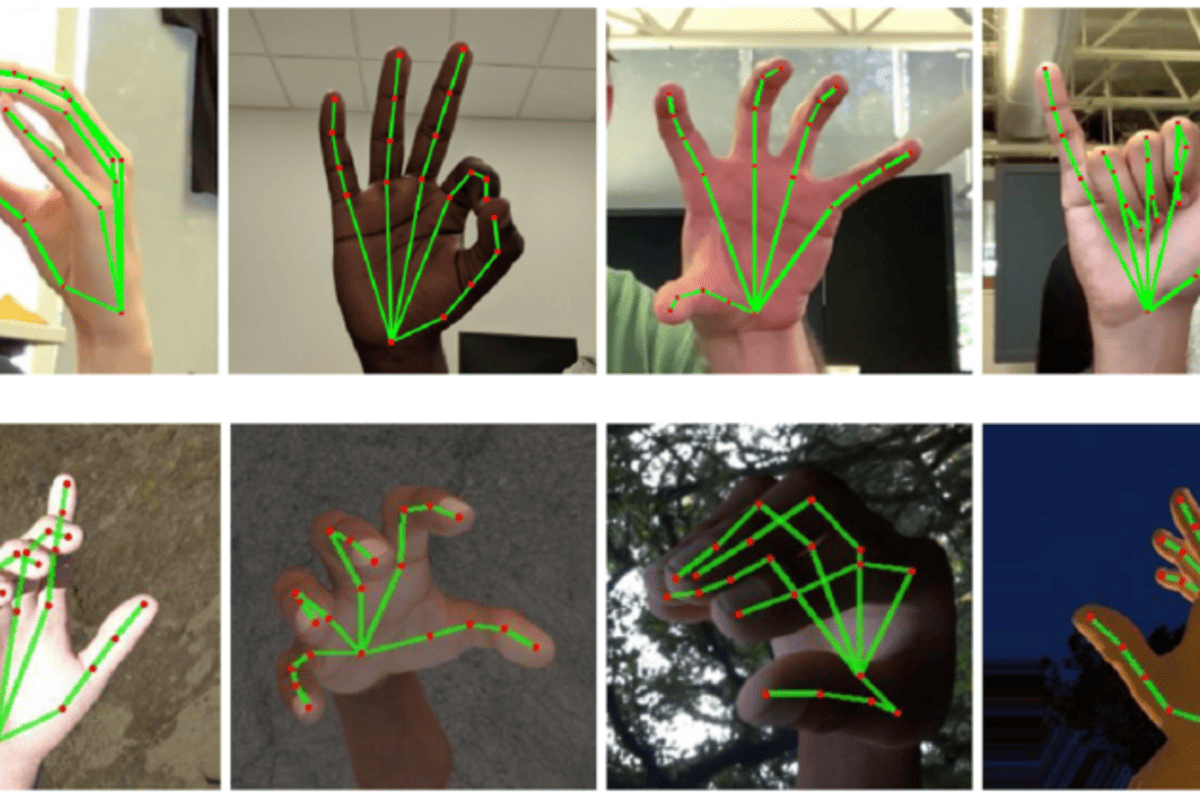

Un « coup de main » prometteur pour comprendre la langue des signes est en action désormais . Une recherche dévoile un logiciel capable d'interpréter les gestes à partir de la caméra d'un smartphone. En plus des 103 langues de Translate, Google pourrait ajouter une nouvelle corde à son arc linguistique : la langue des signes. Dans son laboratoire Google a développé une intelligence artificielle (IA) capable de reconnaître les signes effectués par les doigts d'une main à l’aide d’une image vidéo. Si d'autres ont déjà développé cette technologie comme SignAll ou Kintrans, pour la première fois elle devient utilisable sur smartphone. «Notre méthode permet d’obtenir des performances en temps réel sur un téléphone mobile » expliquent les chercheurs Valentin Bazarevsky et Fan Zhang en charge du programme de développement chez Google. 30 000 photos de main en haute définition. Les scientifiques ont d'abord présenté l'IA au Computer Vision and Pattern Recognition (CVPR) 2019 en juin, en Californie. Mais, ce n'est que très récemment qu'ils ont présenté les avancées de l'outil au grand public. Dans un post, publié le 19 août 2019 sur le blog, l'équipe de chercheurs explique la technologie développée. Valentin Bazarevsky et Fan Zhange indiquent qu’ils ont utilisé plus de 30 000 clichés de mains en très haute définition pour alimenter l’apprentissage de l’IA. Au terme de cette étape, l’équipe de recherche a choisi 21 points clés que le logiciel est capable d’analyser en 3D sur une main.

Rédigé par Energie Mines

La rédaction

Mots clés :

Articles similaires

28 février 2023

Inauguration de la plateforme « Green & Smart Building Park »

23 février 2023

Joint-Venture pour l'EPC des projets solaires

16 novembre 2022

Huawei introduit la 5G et l'IA dans l'industrie minière

10 novembre 2022

Epiroc SmartROC T35 E : premier engin de forage de surface électrique à batterie

9 septembre 2022

IRESEN ET LE GREENTECH INSTITUTE LANCENT L’ÉCOLE D’ÉTÉ DE L’ACADÉMIE DES TECHNOLOGIES PROPRES

13 mars 2022